美报告警告:AI可能构成“毁灭级”威胁,美政府避免灾难的时间不多了

美报告警告:AI可能构成“毁灭级”威胁,美政府避免灾难的时间不多了

【环球时报特约记者 任重】据美国有线电视新闻网(CNN)12 日报道,美国国务院委托第三方机构进行的一份新调查报告称,快速发展的 AI 或对人类构成 " 毁灭级 " 风险。该报告还警告说,美国政府避免灾难的时间已经不多了,必须进行干预。

报告中警告,AI 或对人类构成 " 毁灭级 " 风险。(资料图 图源:美媒)

这份报告由专注于 AI 领域的公司 " 格拉德斯通人工智能 " 撰写。报告基于一年多来对 200 多名 AI 公司高管、网络安全研究人员、大规模杀伤性武器专家和美国国家安全官员的采访,得出 " 在最坏的情况下,最先进的 AI 系统可能对人类构成毁灭级别的威胁 " 的结论。CNN 称,研究人员提出了两个主要危险:首先,最先进的 AI 系统可能会被 " 武器化 ",造成潜在的不可逆转的损害;其次,AI 实验室内部存在担忧,即在某些时候,他们可能会 " 失去对正在开发的系统的控制 ",从而 " 对全球安全造成潜在的破坏性后果 "。

报告将 AI 发展给全球安全带来的风险与核武器相比,称未来 AI 发展存在 " 军备竞赛 "、冲突和 " 大规模杀伤性武器致命事故 " 的风险。CNN 称,最大的不确定因素之一是 AI 的发展速度有多快,尤其是通用人工智能(AGI)的发展速度。报道称,AGI 具有类似人类甚至超越人类的学习能力," 被视为失控导致灾难性风险的主要驱动因素 "。格拉德斯通人工智能的报告称,OpenAI、谷歌 DeepMind 等都公开表示,AGI 可能会在 2028 年实现。

报告还称,AI 可用于设计和实施 " 能够破坏关键基础设施的高效网络攻击 "。一个简单的口头或打字命令,比如 " 实施无法追踪的网络攻击,使北美电网崩溃 ",就可能造成一场灾难。其他风险案例包括由 AI 驱动的 " 大规模 " 虚假宣传活动、武器化机器人应用、心理操纵、武器化生物和材料工程等。报告还提到,竞争压力正在推动企业 " 以牺牲安全和保障为代价 " 加速 AI 的发展,这增加了最先进的 AI 系统可能被窃取并被武器化的风险。

报告呼吁采取重大新措施来应对这一威胁,包括成立一个新的 AI 机构,实施紧急监管,并限制用于训练 AI 模型的计算机能力等。

-

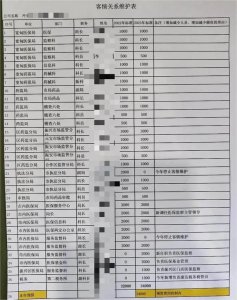

- 辽宁一药房曝出客情维护表,医保部门回应

-

2024-03-16 00:59:36

-

- 估值60亿美元!美国自动驾驶公司Applied Intuition获保时捷领投2.5亿美元

-

2024-03-16 00:57:20

-

- 字节跳动美国投资者准备行动 或通过表决权控制TikTok

-

2024-03-16 00:55:05

-

- “平衡车充电引火灾致4死3伤”后续:平衡车锂电池及充电器不合格,8人落网

-

2024-03-16 00:52:49

-

- AI算力发展带来海量用电需求,上市公司积极行动应对“缺电焦虑”

-

2024-03-14 04:53:58

-

- 联想推出“Daystar Bot GS”机器狗:6 腿设计、IP66 级防水

-

2024-03-14 04:51:42

-

- 3月9日:政协举行第三次全体会议

-

2024-03-14 04:49:27

-

- 阿里大文娱发布“港艺振兴计划”,凤凰云智iCIRENA探索科技出海

-

2024-03-14 04:47:11

-

- 浙商证券:三因素共振,低空经济有望迎来发展热潮

-

2024-03-14 04:44:55

-

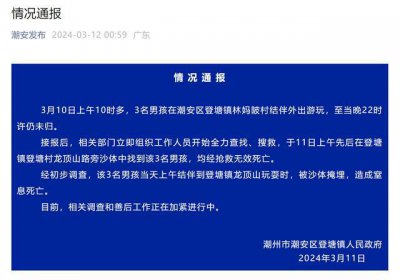

- 广东潮州3名男孩失踪:玩耍时被沙体掩埋,造成窒息死亡

-

2024-03-14 04:42:40

-

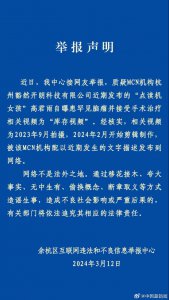

- “点读机女孩视频”经核查,确为“库存视频”!

-

2024-03-14 04:40:24

-

- 消息称字节跳动正开发“Tiktok Photos”与 Instagram 竞争

-

2024-03-14 04:38:08

-

- 两会后首虎!李吉平被查

-

2024-03-14 04:35:53

-

- 暂停转融通借入证券实时可用业务通关测试将于3月16日进行

-

2024-03-14 04:33:37

-

- 奔驰CEO呼吁欧盟降低对华电动汽车关税:保护主义“走错了路”

-

2024-03-13 03:10:06

-

- 让珠海好声音走向基层!“珠海说”志愿宣讲团专场宣讲会举办

-

2024-03-13 03:07:50

-

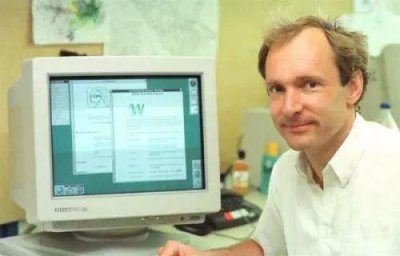

- 35年前的今天:万维网WWW概念正式提出!全称意想不到

-

2024-03-13 03:05:35

-

- SpaceX 5小时内两次发射星链:总数逼近6000颗

-

2024-03-13 03:03:19

-

- 车长超5.3米的理想MEGA市区好停车吗 车主实测:根本不用自己动

-

2024-03-13 03:01:03

-

- 足浴赞助足球!河北一足疗店宣布赞助中超球队沧州雄狮

-

2024-03-13 02:58:47

江西县区最新人事任免公示(重磅江西11地市四套班子全名单出炉)

江西县区最新人事任免公示(重磅江西11地市四套班子全名单出炉) 北京市三位副区长(北京11个区新任16名)

北京市三位副区长(北京11个区新任16名)